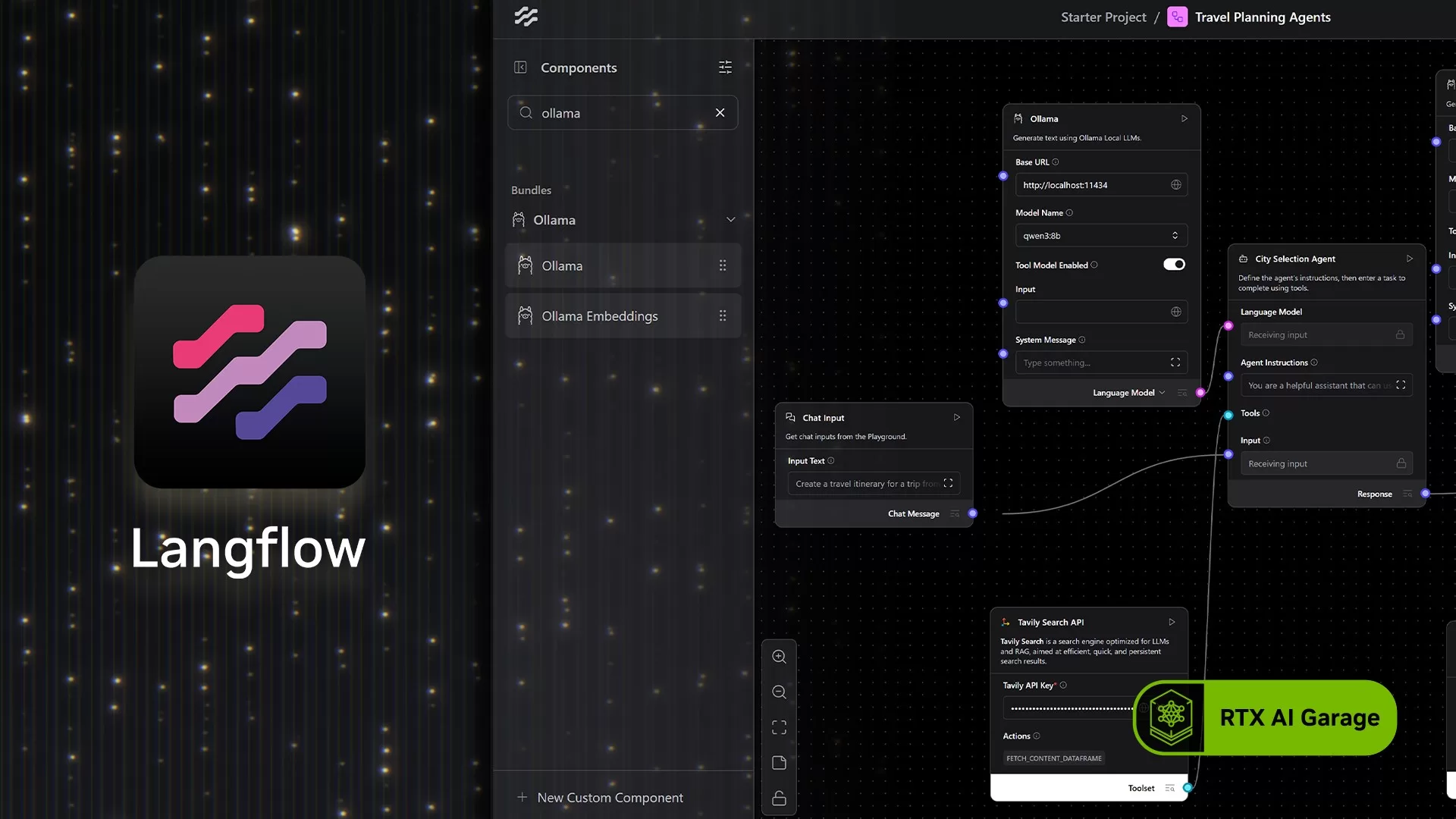

Tento týden se v blogu RTX AI Garage dočtete, jak nadšenci do AI využívají populární aplikaci Langflow k řetězení generativních modelů umělé inteligence. Jde o vizuální platformu s nízkou potřebou kódování pro navrhování vlastních postupů při práci s AI.

A díky nativní integraci do frameworku Ollama mohou nyní uživatelé tyto postupy vytvářet a spouštět bez nákladů na poplatky za cloud a s naprostým soukromím. To vše díky GPU NVIDIA GeForce RTX a RTX PRO.

Langflow může spouštět modely z cloudu nebo lokálně – s plnou akcelerací pro GPU RTX prostřednictvím Ollama. Lokální spouštění pracovních postupů přináší několik klíčových výhod:

- Soukromí dat: Vstupy, soubory a výzvy zůstávají na zařízení.

- Nízké náklady a žádné API klíče: Protože není vyžadován přístup ke cloudovému aplikačnímu programovacímu rozhraní, nejsou s provozem modelů AI spojena žádná omezení v podobě tokenů, nutnosti předplatného služeb a dalších nákladů.

- Výkon: Grafické procesory RTX umožňují odvozování s nízkou latencí a vysokou propustností, a to i při dlouhých kontextových oknech.

- Režim offline: Lokální pracovní postupy pro AI jsou přístupné bez připojení k internetu.

Uživatelé nyní mohou také v Langflow ovládat RTX AI PC s NVIDIA Project G-Assist. Jde o experimentálního AI asistenta v PC, který běží lokálně na počítačích s GeForce RTX. Umožňuje uživatelům dotazovat se na systémové informace, upravovat nastavení systému a další. To vše prostřednictvím jednoduchých výzev v přirozeném jazyce.

Díky komponentě G-Assist v Langflow lze tyto možnosti zabudovat do vlastních pracovních postupů využívajících AI agenty. Uživatelé mohou komponentě G-Assist zadat např. příkaz „zjistit teplotu GPU“ nebo „vyladit otáčky ventilátorů“ a její odpověď i akce budou procházet řetězcem dalších komponent.